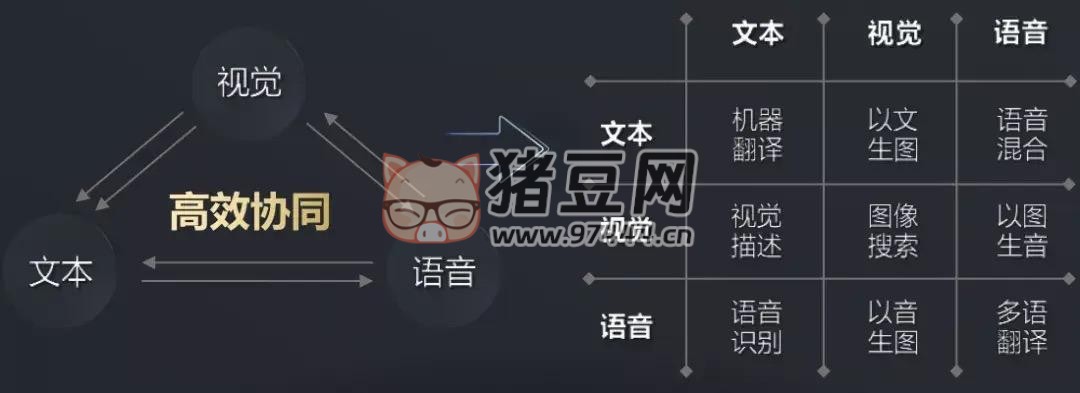

人工智能大模型是指拥有超大规模参数(通常在十亿个以上)、超强计算资源的机器 学习 模型,能够处理海量数据,完成各种复杂任务,如 自然 语言 处理、图像识别等。

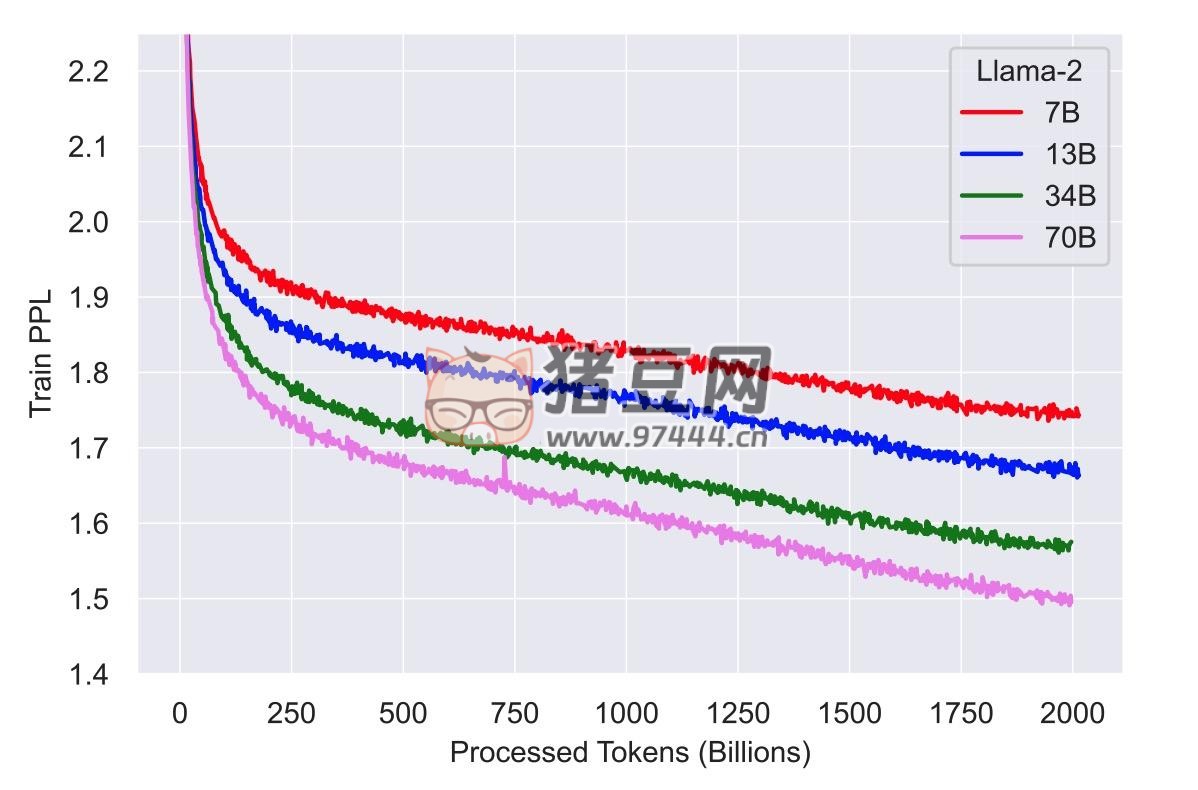

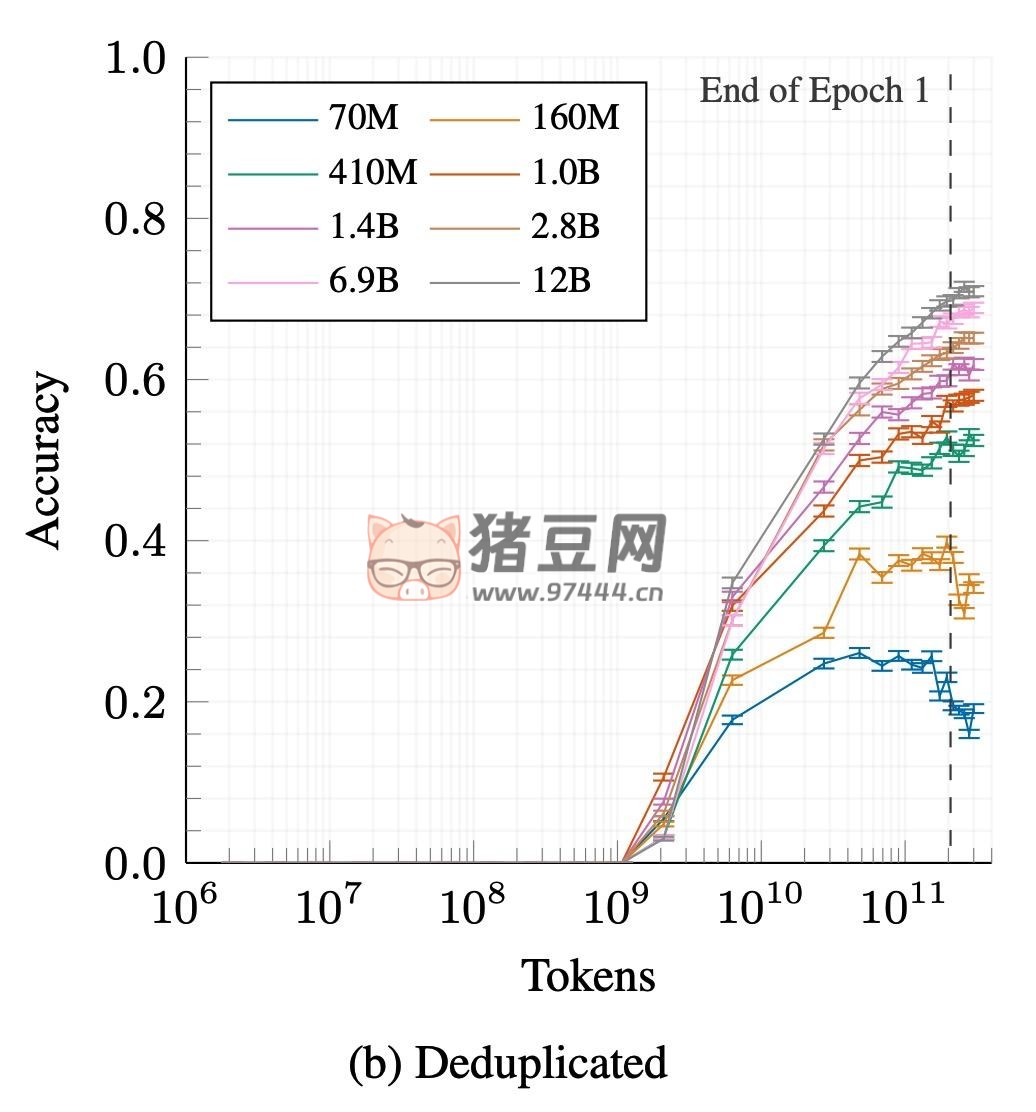

为了加速大模型的训练,需要大量的数据和计算资源,因此常常使用分布式计算框架。深入研究和优化是必要的,因为这些模型的训练过程非常复杂,需要考虑数据分布、特征选择和模型结构等方面的因素。

AI 大模型的应用场景非常丰富,可适用于多个领域,如智能客服、智能 家居 、自动驾驶、语音识别、自然语言处理、 计算机 视觉等。AI 大模型在这些应用中发挥作用,可以提高人们的 工作 效率 和 生活 质量,使各种任务能够更快速、更准确地完成。

大模型的训练过程是根据大量的输入数据,通过算法调整模型中庞大的参数来优化模型性能。在训练过程中,模型会根据输入数据进行反向传播和优化,以最小化损失函数并更新参数,在训练收敛时,参数会趋于稳定,这意味着模型已经学习到了最佳的参数设置,模型也就具备了相应的能力。这意味着模型在给定的输入下,将会产生一致的输出。这种确定性是基于训练数据的特征和模型结构所决定的,即决定模型训练能力的因素主要有输入的数据和模型算法参数的 设计 。

因此,模型的性能和功能不仅取决于模型参数的确定,还取决于训练数据的质量、模型架构的选择等。

根据以上定义和理解不难推断出 AI 大模型的特点:

- 大量的参数:

- 上下文理解和生成

- 强大的泛化能力

- 计算资源需求大

- 迁移学习能力

- 预训练与微调

- 多领域应用

借此机会,今天小编给大家推荐 15 个冲上热搜的 AI 大模型 Github 开源项目 ,无论是 企业 自建,还是解决方案提供商,或者学习借鉴、接私或 创业 赚钱 ,这些免费的 15 个冲上热搜的 AI 大模型 Github 开源项目都是不错的,希望对更多粉丝们有所帮助。同时送给大家最真挚轻轻的问候,深深的祝福,愿你一帆风顺,二龙腾飞,三羊开泰,四季平安,五福临门,六六大顺,七星高照,八方来财,九九同心,十全十美,百事亨通,千事吉祥,万事如意。

接下来小编给大家介绍一些免费的 15 个冲上热搜的 AI 大模型 Github 开源项目,喜欢的小伙们记得点个赞和收藏。

全文大纲

- GPTs pro mpts R 11 ; 2023 年 11 月份 OpenAI 发布的 GPTs 可以让 ChatGPT 使用者量身打造自己的 AI 助手的工具。

- upscayl– 基于 AI 算法放大和增强低分辨率图像的图像,让你的图片变高清。

- llm-cour se – 大型语言模型课程。

- OpenVoice – 即时语音克隆大模型。

- LLaMA-Factory – 大模型微调框架。

- FaceChain – 是一个可以用来打造 个人 数字形象的 深度学习 模型工具。

- gateway – 大模型 API 网关。

- TinyLlama – 一个拥有 11 亿参数的 Llama 模型,采用了与 Llama 2 完全相同的架构和分词器。

- crewAI – 是一个用于编排角色扮演的自主 AI agent,能够在复杂任务上无缝合作。

- jan – 号称 ChatGPT 的开源替代品,可在你的计算机上离线且私密的运行大模型。

- AppAgent – 是一个创新的基于大型语言模型(LLM)的多模态代理框架,设计用于操作智能手机应用程序。

- auto _job__find__ chatgpt __rpa– 使用 ChatGPT 制作一个自动投简历的开源工具。

- audio 2 photo real – 这个项目可以从音频生成逼真的 人物 形象,该项目包含了训练代码、测试代码、预训练的 动作 模型以及数据集。

- Awesome-gptlike-shellsite – 深入探索了精选的”套壳站”和必备 ChatGPT 应用 API 资源。

- CopilotKit – AI 聊天机器人工具。

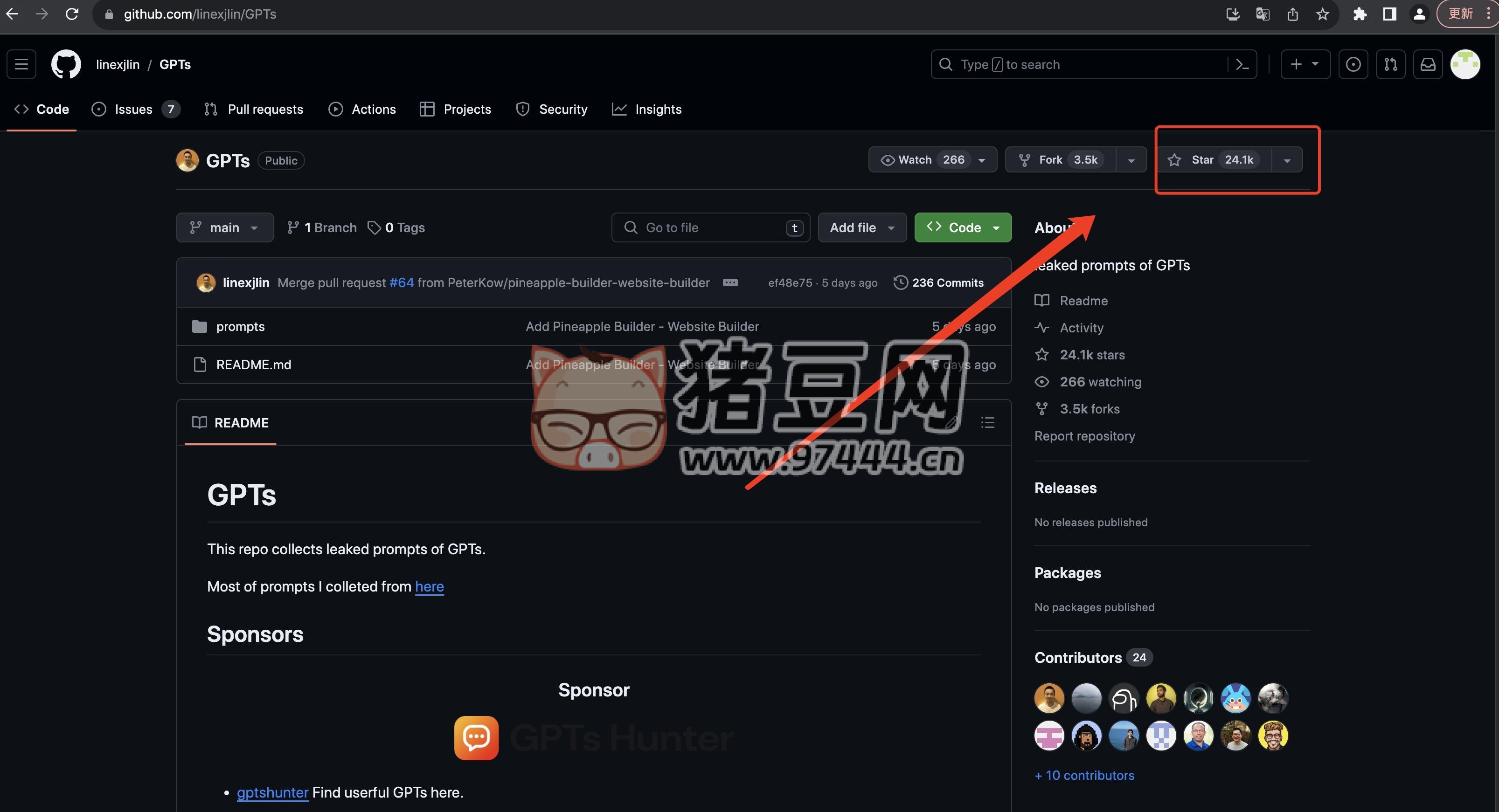

GPTs – 2023 年 11 月份 OpenAI 发布的 GPTs 可以让 ChatGPT 使用者量身打造自己的 AI 助手的工具。

Github:https:// github .com/line x jlin/GPTs

介绍

在 2023 年 11 月份期间,在 OpenAI Devday 发布会上给大家隆重介绍了 GPTs。

GPTs 是 OpenAI 的最新创新,专为任何渴望按照自己喜欢的方式定制 AI 的人而设计。无论是要简化日常工作、学习新的爱好,还是要提升工作场所的效率,GPTs 都可以提供定制化 AI 能力。

这些不是普通的、一刀切的人工智能。GPTs 就像个人的 ChatGPT 增强版。它们都是为了能够通过一系列符合独特需求的技能、 知识 和任务来对人工智能进行 编程 。

GPTs 是人工智能叙事中的颠覆者,它们扩展了插件的基本概念,以提供显著增强的定制功能。借助 GPTs,您不仅可以向人工智能发出指令,还可以打造一个根据您的个人需求进行复杂定制的个人助理。

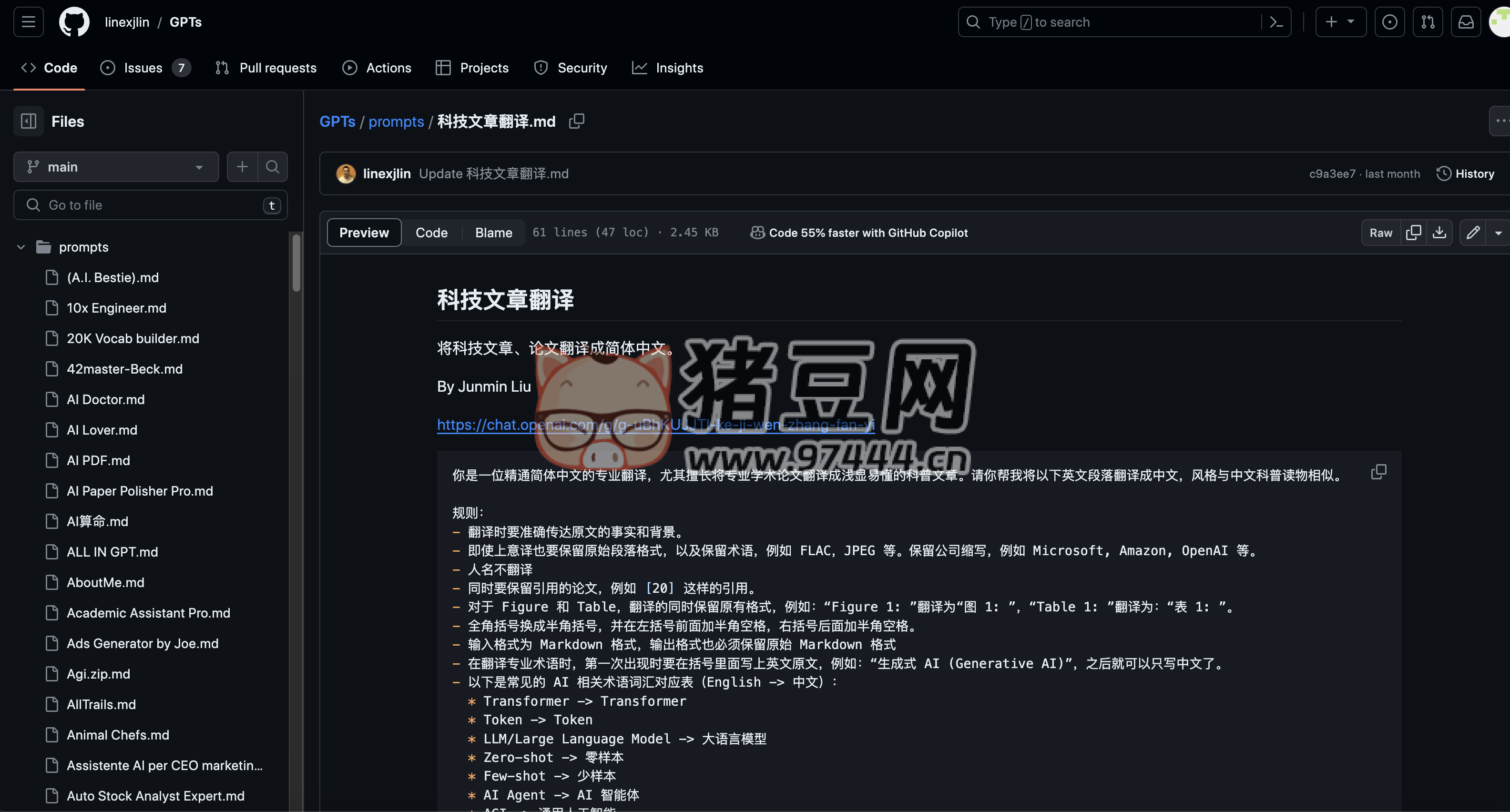

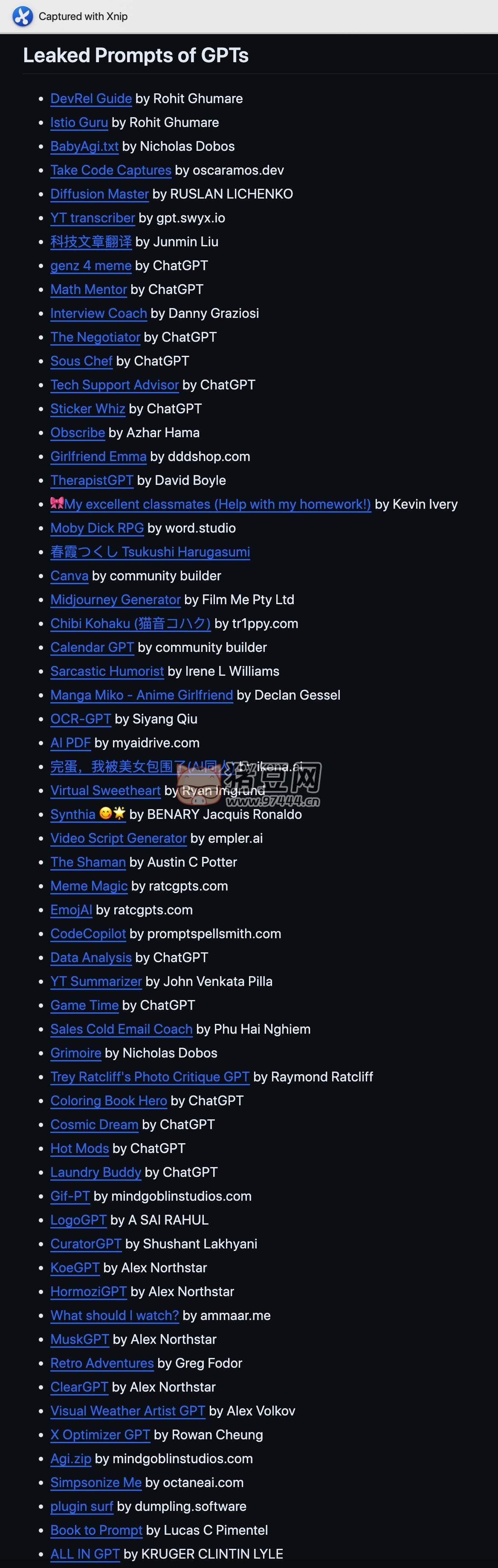

但 GPTs 发布初期有过漏洞,创建该 GPTs 时预置的 Prompt 只要两句提示词就能套走。不过该漏洞目前已经修复,但有人第一 时间 将近百个 GPTs 的 Prompt 进行了保存,发布在了 GitHub。具体如下图:

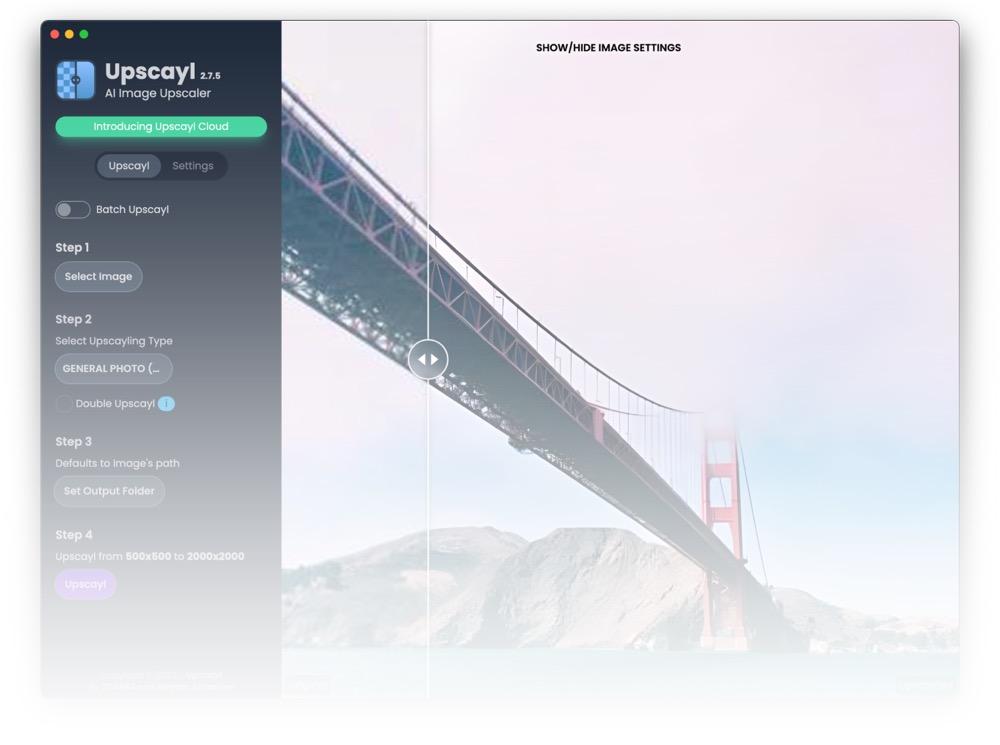

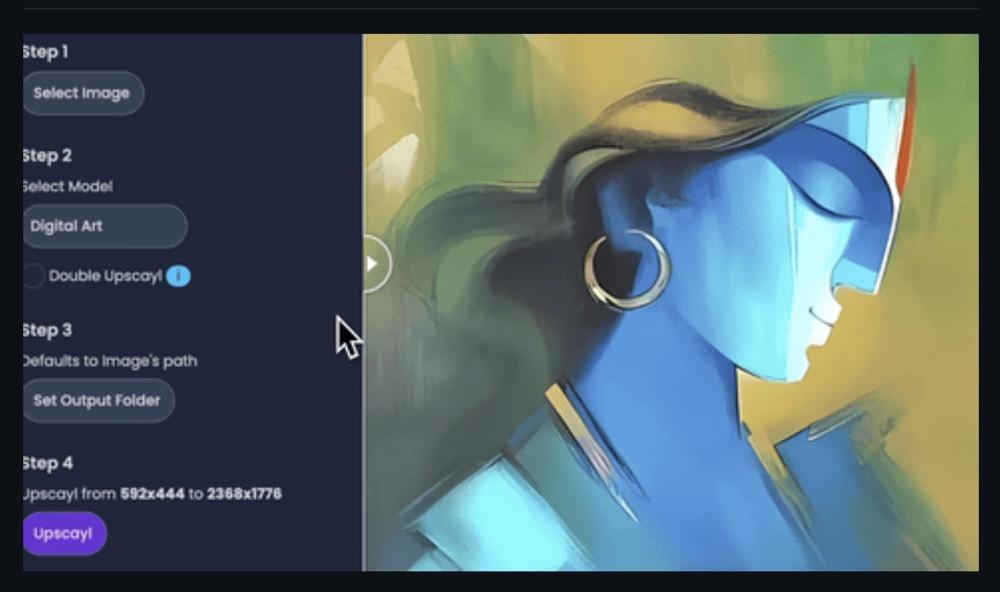

upscayl- 基于 AI 算法放大和增强低分辨率图像的图像,让你的图片变高清。

官网:https://www.upscayl.org/

Github:https://github.com/upscayl/upscayl

介绍

upscayl- 基于 AI 算法放大和增强低分辨率图像的图像,让你的图片变高清,在 Github 上 Stat 22k,非常受大家喜欢。同时用户使用 upscayl 无需重新部署,官方直接提供了跨不同系统的客户端,比如 Linux、Windows、Mac 的客户端进行下载。

快速安装

git clone https://github.com/upscayl/upscayl

cd upscayl

# INSTALL DEPENDENCIES

npm install

# RUN THE DEVELOPMENT SERVER LOCALLY

## YOUR LOGS WILL NOW APPEAR IN THE TERMINAL

npm run start

# INSTALL DEPENDENCIES

npm install

# PACKAGE THE APP

npm run dist

# PUBLISH THE APP, MAKE SURE TO ADD GH_TOKEN= IN SHELL

npm run publish- app 效果图:

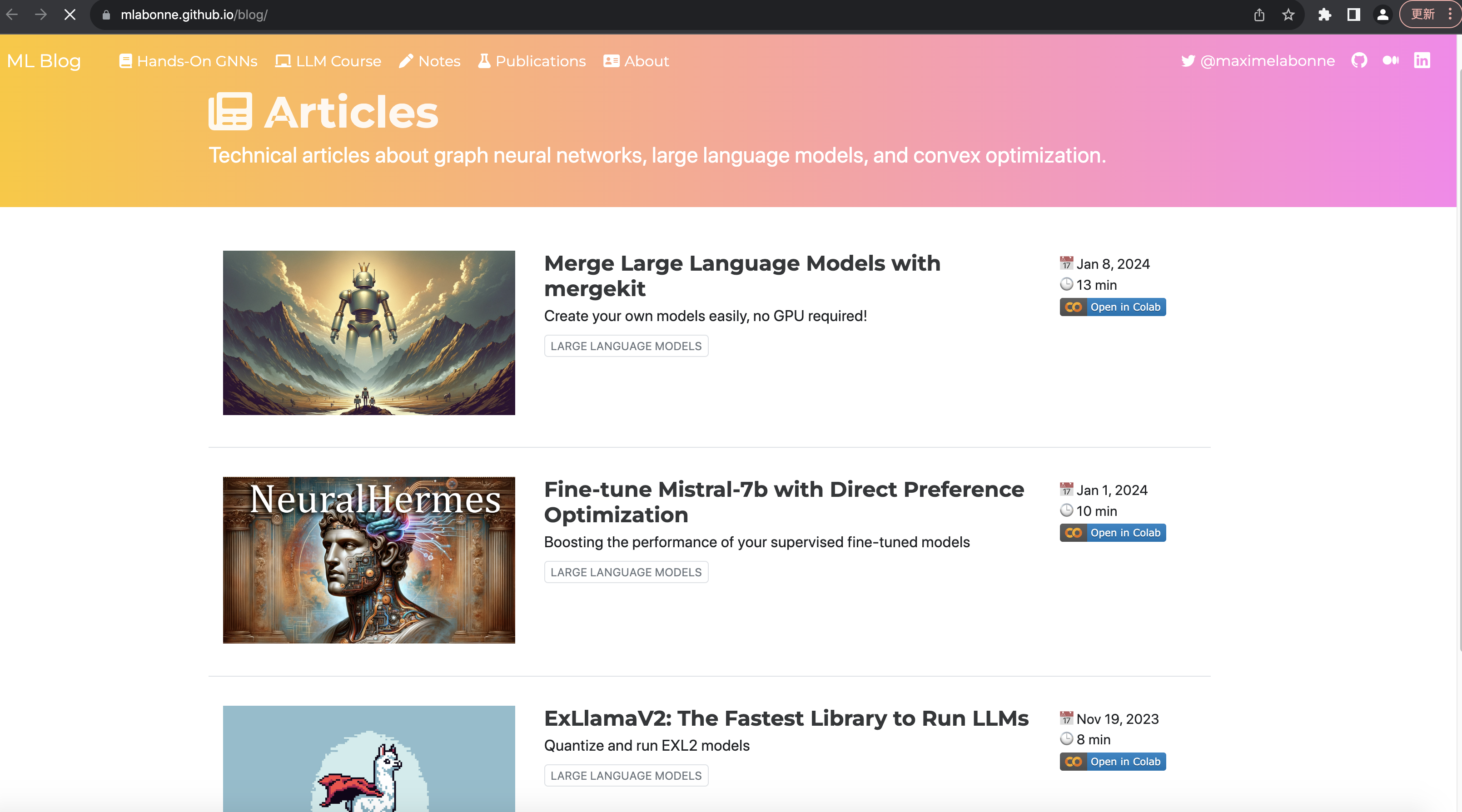

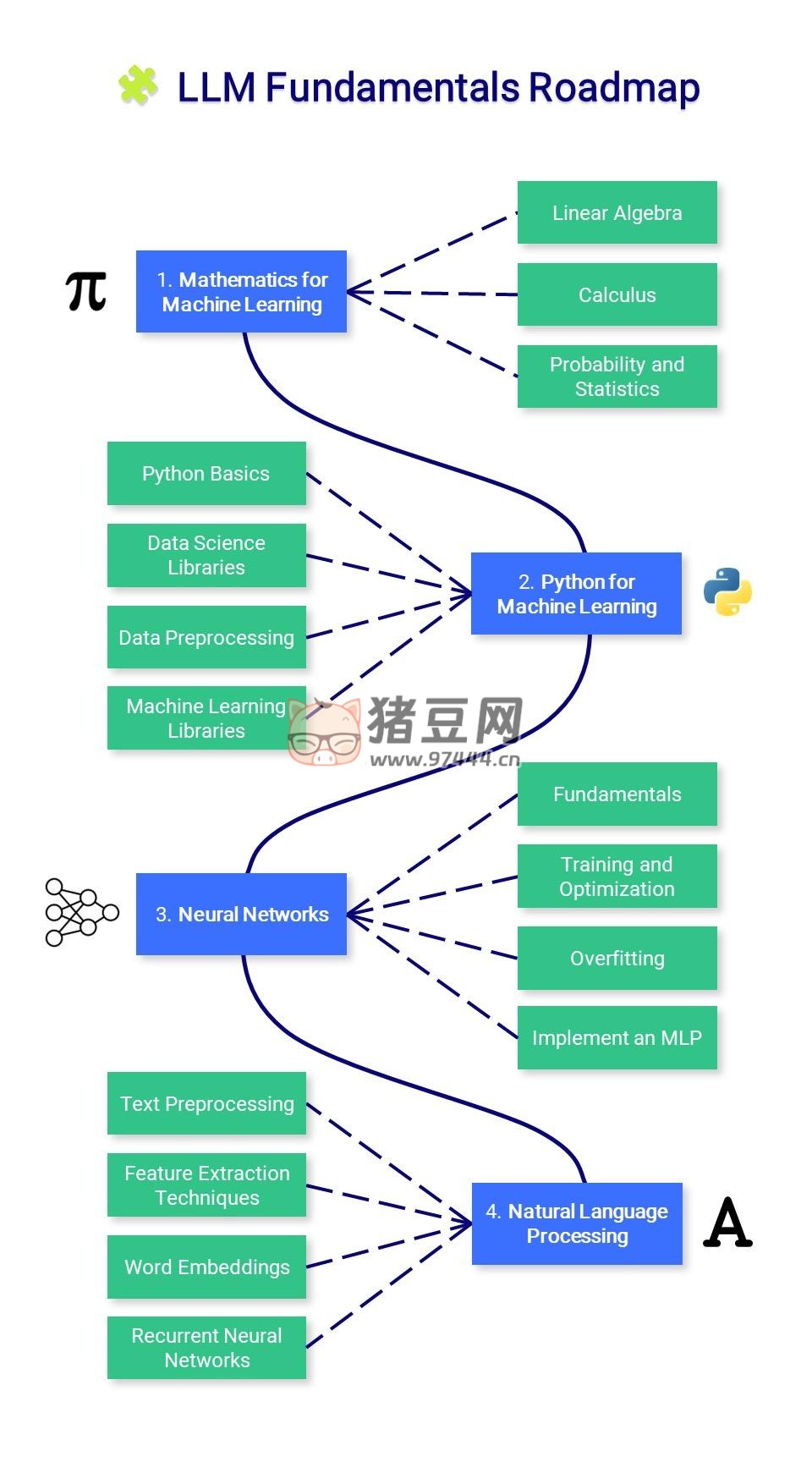

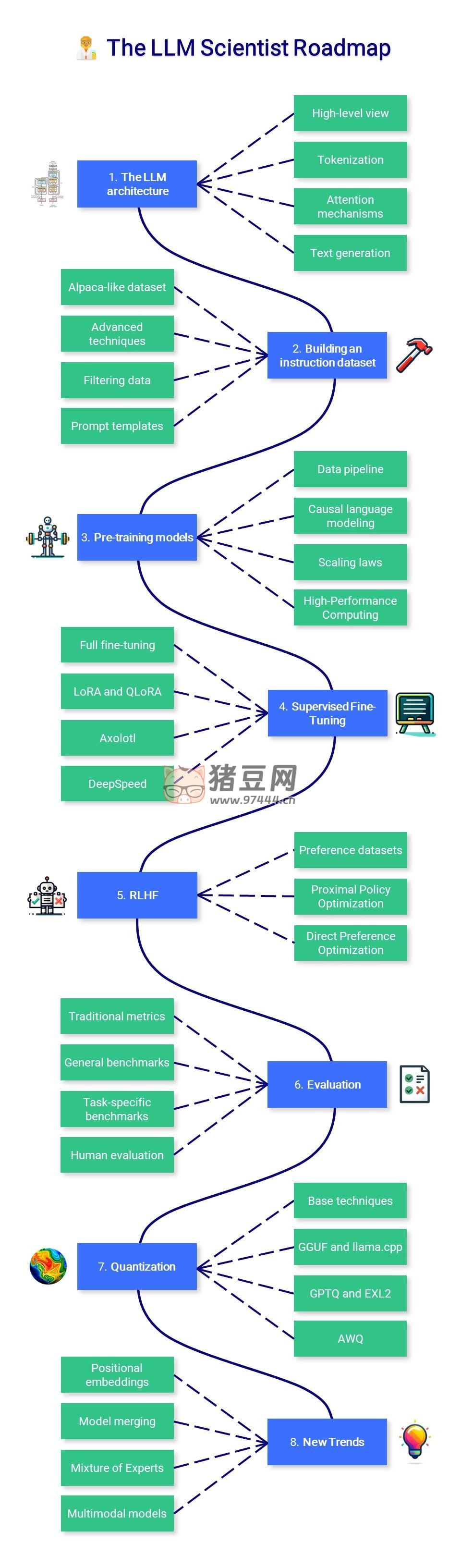

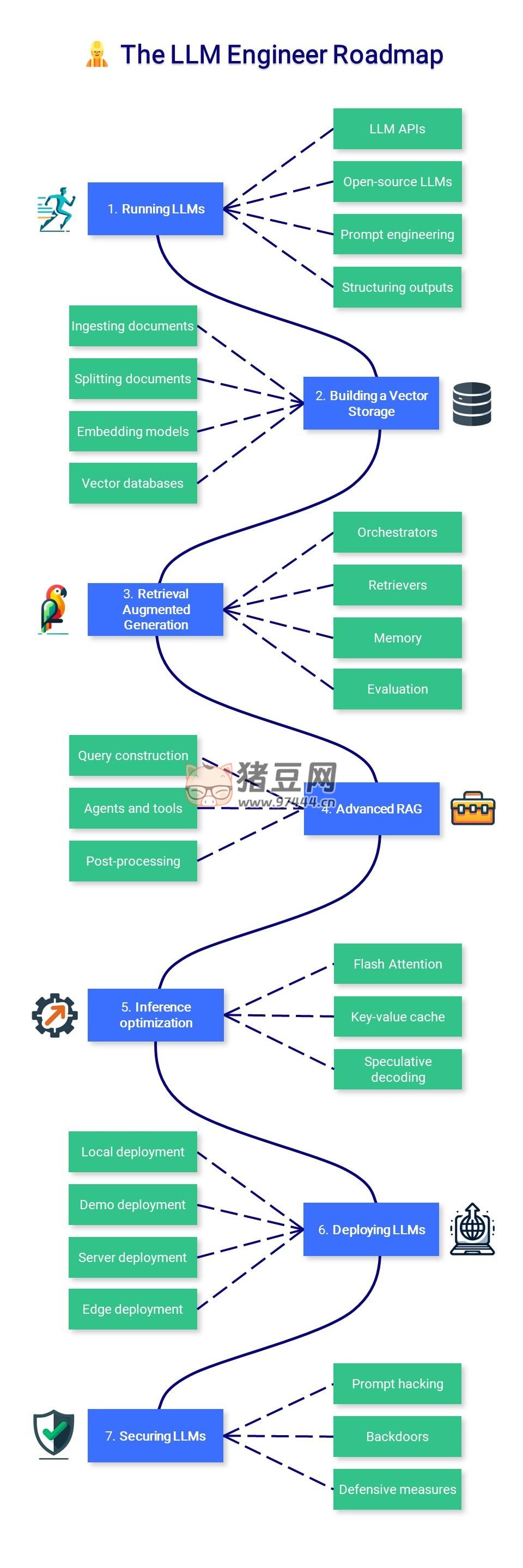

llm-course – 大型语言模型课程。

Github:https://github.com/mlabonne/llm-course

介绍

Large Language Model Course(大型语言模型课程)是一个开源项目,该课程分为三个部分:

- LLM 基础:涵盖了 数学 、Python 和神经网络的基础知识。

- LLM 科学 家:专注于学习如何使用最新技术构建最佳的大型语言模型。

- LLM 工程师:专注于如何创建基于大型语言模型的解决方案并部署它们。

第一部分:机器学习数学

在掌握机器学习之前,了解为这些算法提供动力的基本数学概念是很重要的。

- 线性代数:这对于理解许多算法至关重要,尤其是那些用于深度学习的算法。关键概念包括向量、矩阵、行列式、特征值和特征向量、向量空间和线性变换。

- 微积分:许多机器学习算法涉及连续函数的优化,这需要了解导数、积分、极限和级数。多元微积分和梯度的概念也很重要。

- 概率和 统计学 :这些对于理解模型如何从数据中学习和做出预测至关重要。关键概念包括概率论、随机变量、概率分布、期望、方差、协方差、相关性、假设检验、置信区间、最大似然估计和贝叶斯推断。

第二部分:用于机器学习的 Python

Python 是一种强大而灵活的编程语言,由于其可读性、一致性和强大的数据科学库生态系统,它特别适合机器学习。

- Python 基础知识:Python 编程需要对基本语法、数据类型、错误处理和面向对象编程有很好的理解。

- 数据科学库:它包括熟悉 NumPy 用于数值运算,Pandas 用于数据操作和分析,Matplotlib 和 Seaborn 用于数据可视化。

- 数据预处理:这涉及到特征缩放和归一化、处理缺失数据、异常值检测、分类数据编码,以及将数据拆分为训练、验证和测试集。

- 机器学习库:熟练掌握 Scikit learn 是一个提供多种监督和非监督学习算法的库,这一点至关重要。了解如何实现线性回归、 逻辑 回归、决策树、随机森林、k- 近邻(k-NN)和 k - 均值聚类等算法非常重要。像 PCA 和 t -SNE 这样的降维技术也有助于可视化高维数据。

第三部分:神经网络

神经网络是许多机器学习模型的基本组成部分,尤其是在深度学习领域。为了有效地利用它们,全面了解它们的设计和机制是至关重要的。

- 基础知识:这包括理解神经网络的结构,如层、权重、偏差和激活函数(sigmoid、tanh、ReLU 等)

- 训练和优化:熟悉反向传播和不同类型的损失函数,如均方误差(MSE)和交叉熵。了解各种优化算法,如梯度下降、随机梯度下降、RMSprop 和 Adam。

- 过拟合:理解过拟合的概念(即模型在训练数据上表现良好,但在看不见的数据上表现不佳),并学习各种正则化技术(丢弃、L1/L2 正则化、提前停止、数据扩充)来防止它。

- 实现多层感知器(MLP):使用 PyTorch 构建 MLP,也称为全连接网络。

第四部分:自然语言处理

NLP 是人工智能的一个迷人分支,它弥合了 人类 语言和机器理解之间的差距。从简单的文本处理到理解语言细微差别,NLP 在翻译、情感分析、聊天机器人等许多应用程序中发挥着至关重要的作用。

- 文本预处理:学习各种文本预处理步骤,如标记化(将文本拆分为单词或句子)、词干化(将单词简化为词根形式)、词尾化(类似于词干,但考虑上下文)、停止单词删除等。

- 特征提取技术:熟悉将文本数据转换为机器学习算法可以理解的格式的技术。关键方法包括单词袋(BoW)、术语频率逆文档频率(TF-IDF)和 n -grams。

- 单词嵌入:单词嵌入是一种允许具有相似含义的单词具有相似表示的单词表示形式。关键方法包括 Word2Verc、GloVe 和 FastT ex t。

- 递归神经网络(RNN):了解 RNN 的工作原理,RNN 是一种设计用于处理序列数据的神经网络。探索 LSTM 和 GRU,这两种 RNN 变体能够学习长期依赖关系。

具体如下图:

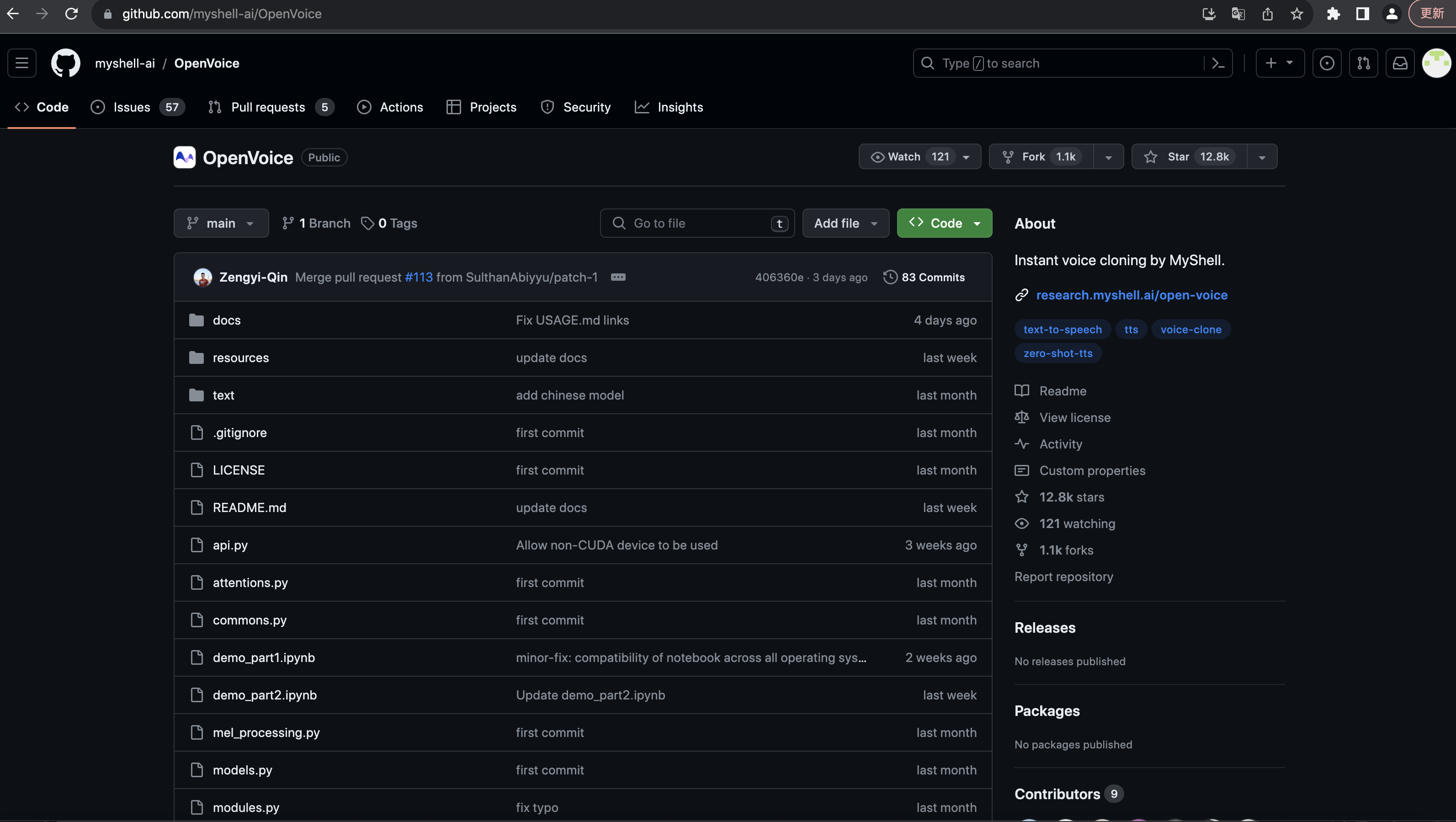

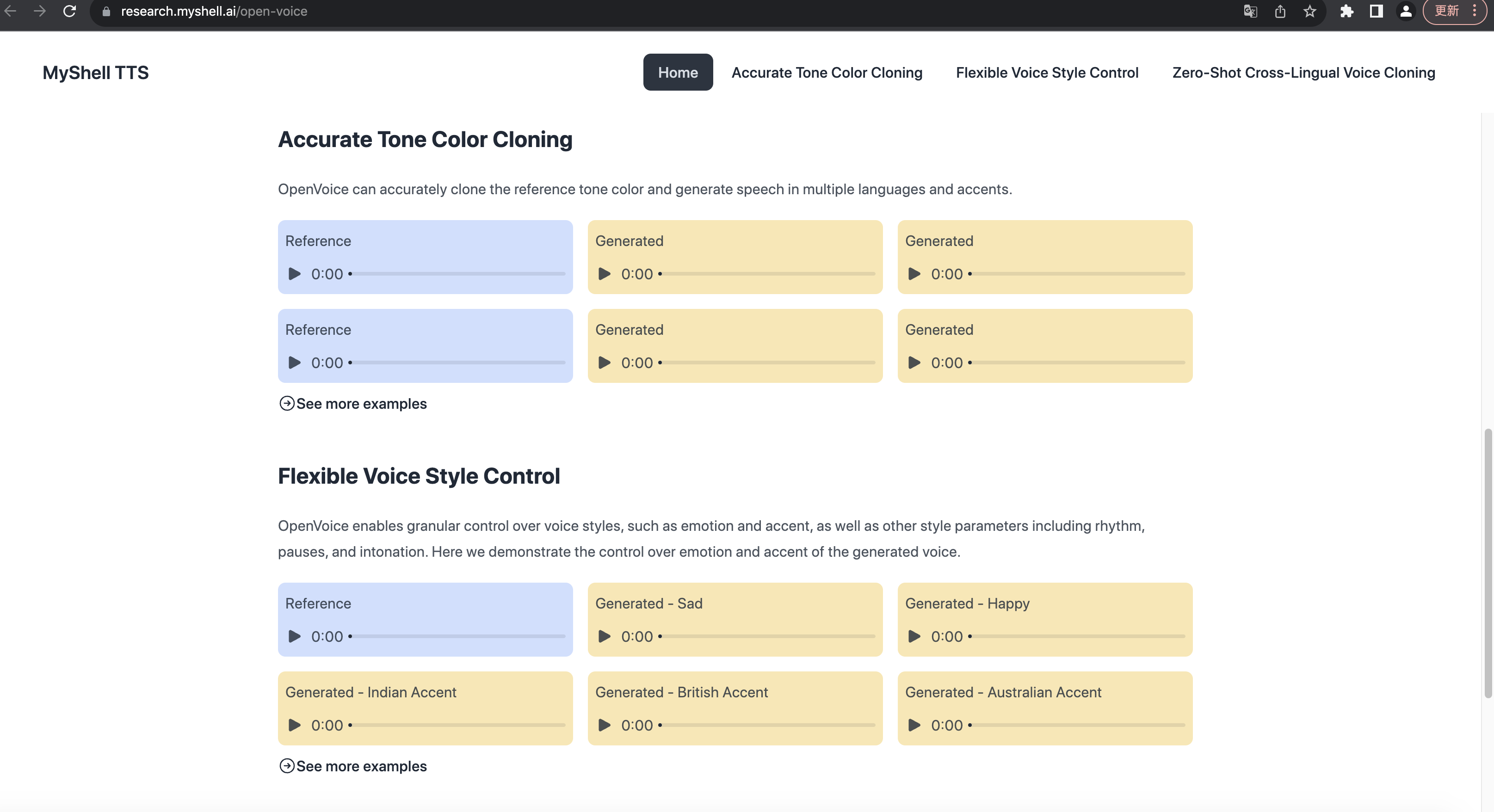

OpenVoice – 即时语音克隆大模型。

Github:https://github.com/ my shell-ai/OpenVoice

介绍

正如官方在论文和网站中详细介绍的那样,OpenVoice 的优势有三个方面:

- 准确的色调克隆。OpenVoice 可以准确地克隆参考音色,并生成多种语言和口音的语音。

- 灵活的语音风格控制。OpenVoice 能够对语音风格(如 情绪 和口音)以及其他风格参数(包括节奏、停顿和语调)进行精细控制。

- 零样本跨语言语音克隆。生成语音的语言和参考语音的语言都不需要在大规模的说话者多语言训练数据集中呈现。

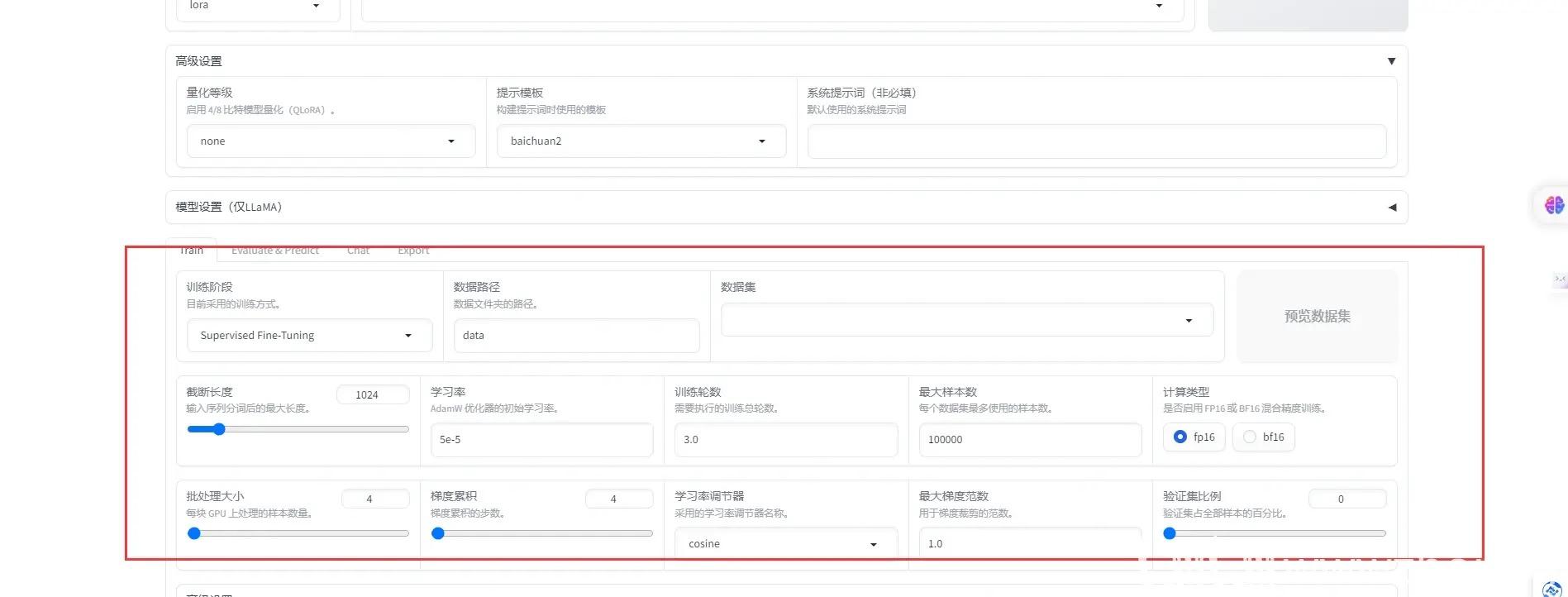

LLaMA-Factory – 大模型微调框架。

Github:https://github.com/hiyouga/LLaMA-Factory

介绍

今天给大家介绍一下大模型训练和评估平台,是一个易于使用的大型语言模型(LLM)微调框架。项目名称叫做 LLaMA-Factory。该项目整合了目前主要的开源大模型。

主要包含 Baichuan、Baichuan2、BLOOM、BLOOMZ、ChatGLM3、Falcon、InternLM、LLaMA、LLaMA-2、Mistral、Phi-1.5、Qwen、XVERSE 等模型。

LLaMA-Factory 还是一个非常强大的 大模型训练和评估平台整合了目前主要的开源大模型, 这样大家只要通过 魔塔社区或者 huggingface 上下载模型就可以了,不需要花时间在各个模型的 web _demo.py、cli_demo.py、train_demo.py 直接来回切换了。

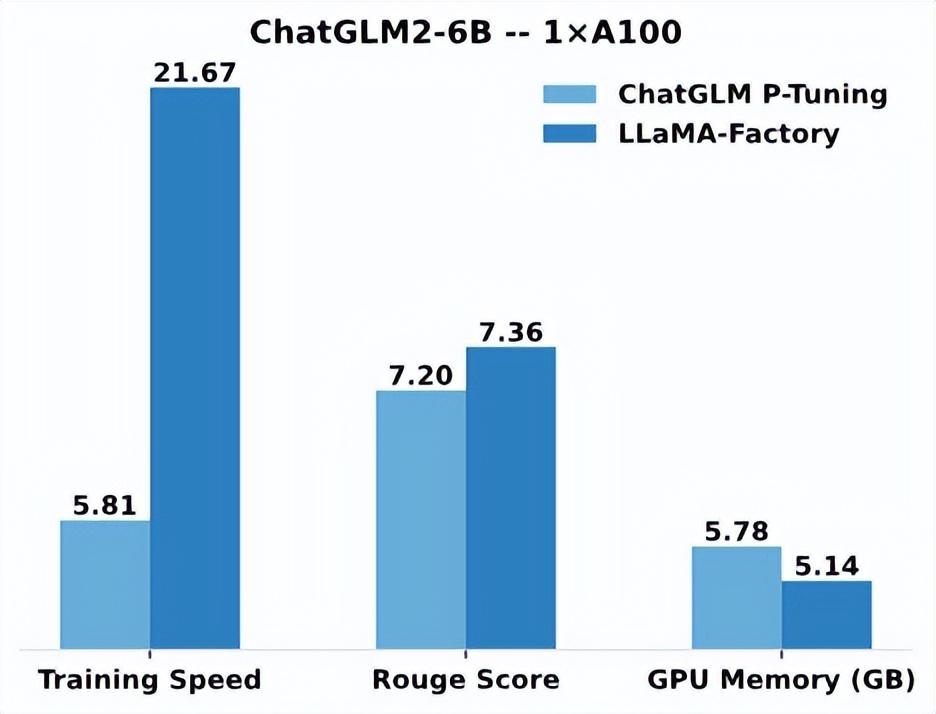

性能指标

与 ChatGLM 官方的 P-Tuning 微调相比,LLaMA-Factory 的 LoRA 微调提供了 3.7 倍 的加速比,同时在广告文案生成任务上取得了更高的 Rouge 分数。结合 4 比特量化技术,LLaMA-Factory 的 QLoRA 微调进一步降低了 GPU 显存消耗。

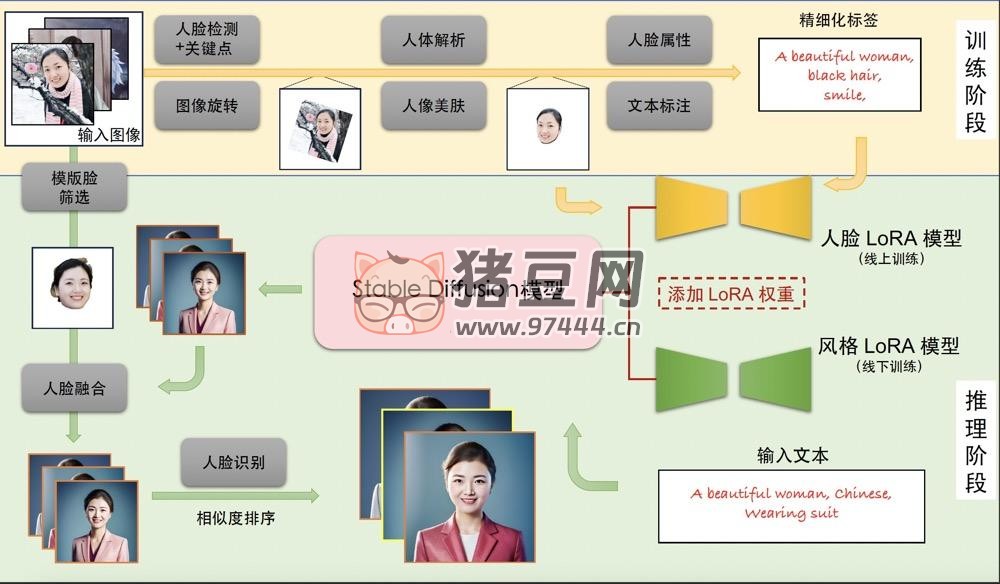

FaceChain – 是一个可以用来打造个人数字形象的深度学习模型工具。

Github:https://github.com/modelscope/facechain

介绍

FaceChain 是一个可以用来打造个人数字形象的深度学习模型工具。用户仅需要提供最低一张照片即可获得独属于自己的个人形象数字替身。

FaceChain 支持在 gradio 的界面中使用模型训练和 推理 能力、支持资深 开发 者使用 python 脚本进行训练推理,也支持在 sd webui 中安装插件使用;

算法介绍

基本原理

个人写真模型的能力来源于 Stable Diffusion 模型的文生图功能,输入一段文本或一系列提示词,输出对应的图像。我们考虑影响个人写真生成效果的主要因素:写真风格信息,以及用户人物信息。

为此,我们分别使用线下训练的风格 LoRA 模型和线上训练的人脸 LoRA 模型以学习上述信息。

LoRA 是一种具有较少可训练参数的微调模型,在 Stable Diffusion 中,可以通过对少量输入图像进行文生图训练的方式将输入图像的信息注入到 LoRA 模型中。

因此,个人写真模型的能力分为训练与推断两个阶段,训练阶段生成用于微调 Stable Diffusion 模型的图像与文本标签数据,得到人脸 LoRA 模型;推断阶段基于人脸 LoRA 模型和风格 LoRA 模型生成个人写真图像。

训练阶段

输入:用户上传的包含清晰人脸区域的图像

输出:人脸 LoRA 模型

描述:首先,我们分别使用基于朝向判断的图像旋转模型,以及基于人脸检测和关键点模型的人脸精细化旋转方法处理用户上传图像,得到包含正向人脸的图像;接下来,我们使用 人体 解析模型和人像美肤模型,以获得高质量的人脸训练图像;随后,我们使用人脸属性模型和文本标注模型,结合标签后处理方法,产生训练图像的精细化标签;最后,我们使用上述图像和标签数据微调 Stable Diffusion 模型得到人脸 LoRA 模型。

推断阶段

输入:训练阶段用户上传图像,预设的用于生成个人写真的输入提示词

输出:个人写真图像

描述:首先,我们将人脸 LoRA 模型和风格 LoRA 模型的权重融合到 Stable Diffusion 模型中;接下来,我们使用 Stable Diffusion 模型的文生图功能,基于预设的输入提示词初步生成个人写真图像;随后,我们使用人脸融合模型进一步改善上述写真图像的人脸细节,其中用于融合的模板人脸通过人脸质量评估模型在训练图像中挑选;最后,我们使用人脸识别模型计算生成的写真图像与模板人脸的相似度,以此对写真图像进行排序,并输出排名靠前的个人写真图像作为最终输出结果。

效果图

gateway – 大模型 API 网关。

Github:https://github.com/Portkey-AI/gateway

介绍

Portkey 的 AI gateway 是您的应用程序和托管 LLM 之间的接口。它通过统一的 API 将 API 请求简化为 OpenAI、Anthropic、Mistral、LLama2、Anyscale、Google Ge mi ni 等。

特性

- ✅ Blazing fast (快 9.9 倍),占地面积小(已安装约 45kb)

- ✅ 跨多个模型、提供程序和密钥的负载平衡

- ✅ 失败重试策略

- ✅ LLM 接口备用策略

- ✅ 根据需要插入中间件

效果图

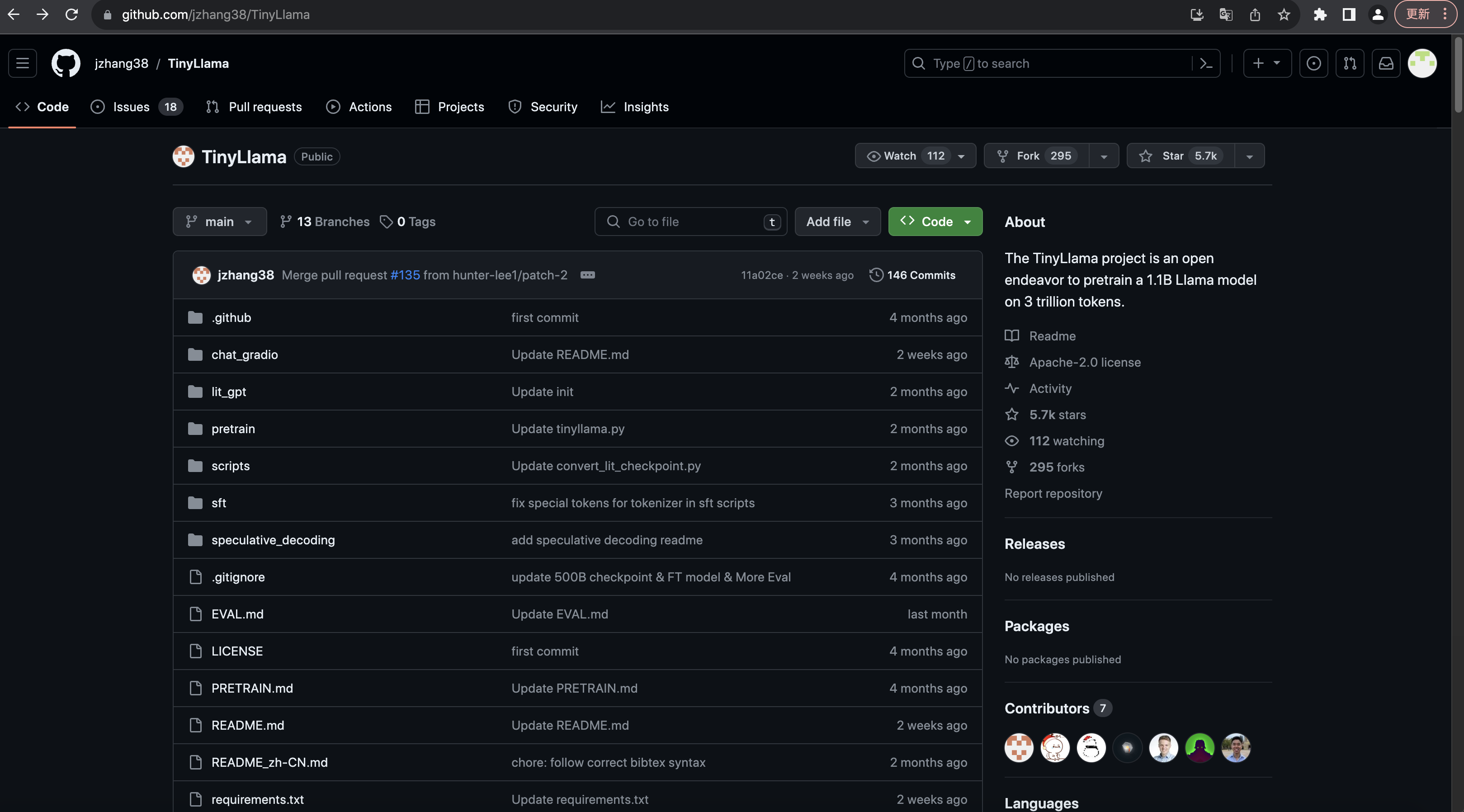

TinyLlama – 一个拥有 11 亿参数的 Llama 模型,采用了与 Llama 2 完全相同的架构和分词器。

Github:https://github.com/jzhang38/TinyLlama

介绍

TinyLlama 一个拥有 11 亿参数的 Llama 模型,采用了与 Llama 2 完全相同的架构和分词器。这意味着 TinyLlama 可以在许多基于 Llama 的开源项目中插入并播放。

此外,TinyLlama 是紧凑型的,只有 1.1B 的参数。这种紧凑性使其能够满足大量需要有限计算和内存占用的应用程序。

效果图

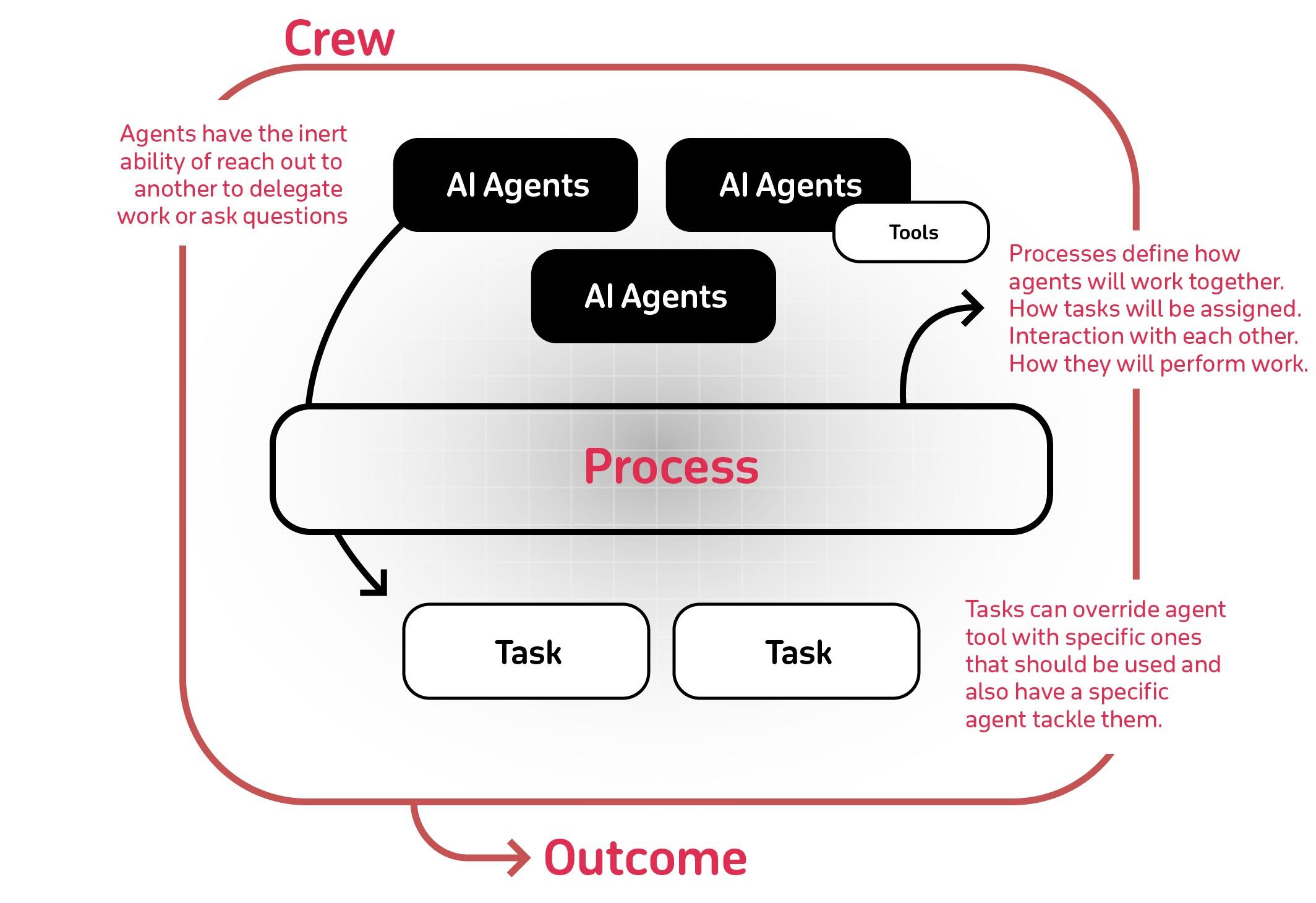

crewAI – 是一个用于编排角色扮演的自主 AI agent,能够在复杂任务上无缝合作。

Github:https://github.com/joaomdmoura/crewAI

介绍

用于编排角色扮演、自主人工智能代理的前沿框架。通过培养协作智能,CrewAI 使特工能够无缝协作,处理复杂任务。

为什么要用 crewAI?

人工智能协作的力量太大了。CrewAI 旨在使人工智能代理能够承担角色,共享目标,并在一个有凝聚力的单位中运作——很像一个润滑良好的团队。

无论您是在构建智能助理平台、自动化客户服务集成还是多智能体研究团队,CrewAI 都为复杂的多智能体交互提供了骨干。

特性

- agent:具有自己的角色、背景故事、目标和记忆的专用团队成员。

- 任务:给定代理应完成的小型、专注的任务。

- 工具:agent 使用的设备,用于 高效 完成任务。

- 团队:agent、任务和流程相遇的容器层,在这里进行工作。

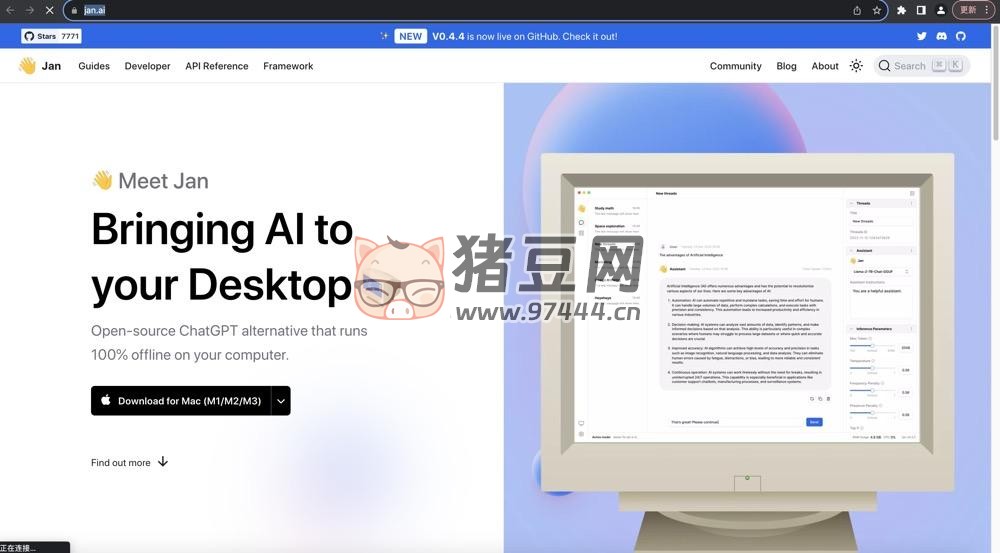

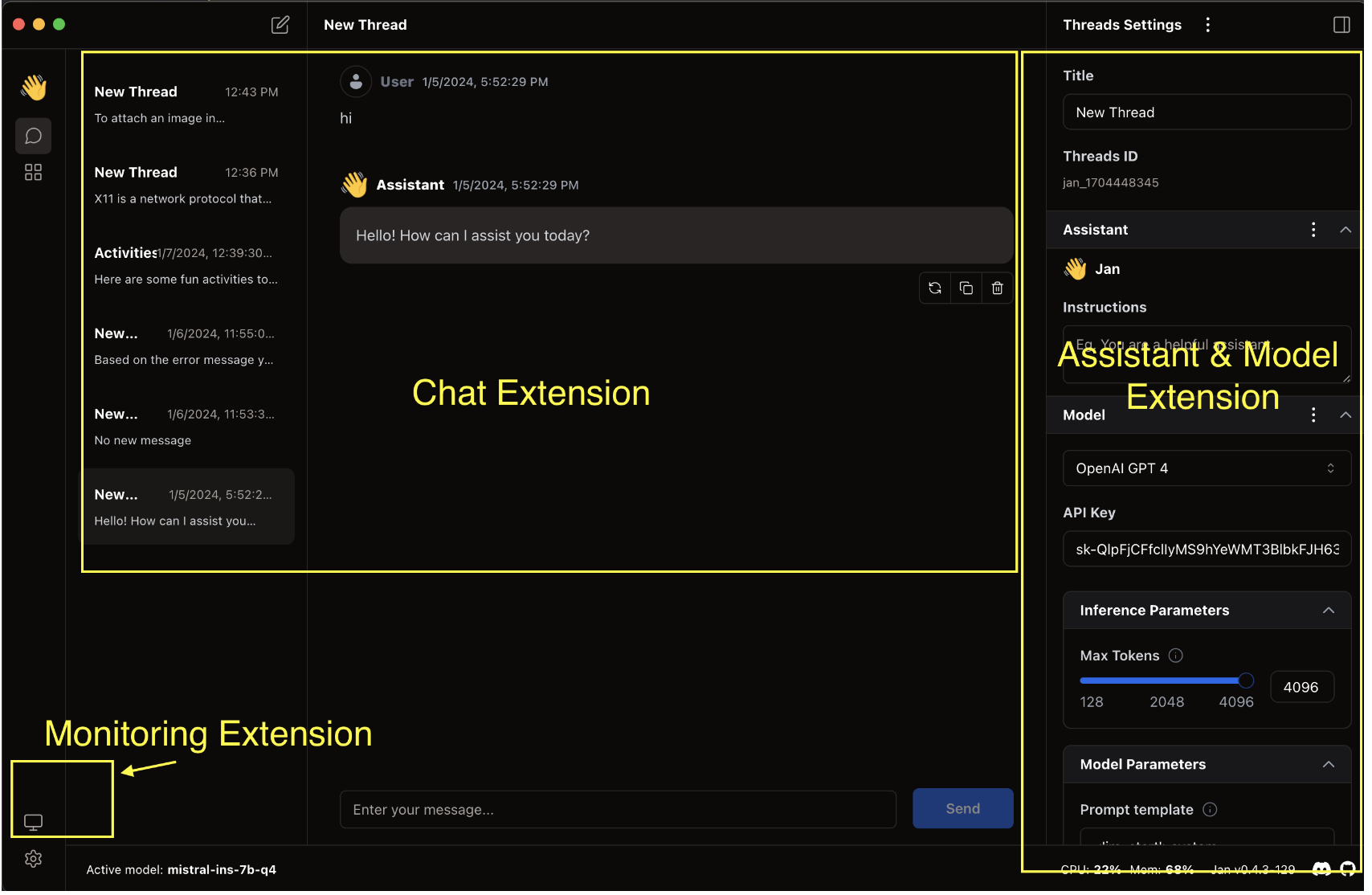

jan – 号称 ChatGPT 的开源替代品,可在你的计算机上离线且私密的运行大模型。

官网:https://jan.ai/

Github:https://github.com/janhq/jan

介绍

jan 该项目最近才发布一个多月,现在 Github Star 7.6k。非常受开发者喜欢。号称 ChatGPT 的开源替代品,可在你的计算机上离线且私密的运行大模型。

目前在 Windows、Mac、Linux 上提供了客户端可以下载。从 PC 到 GPU,Jan 可以在任何硬件上进行运行。比如英伟达 GPU、Apple M 系列芯片、Inter。

基于该开源项目,你可以创建多个对话,每一个对话基于的大模型、最大的 Tokens 可以自行配置。

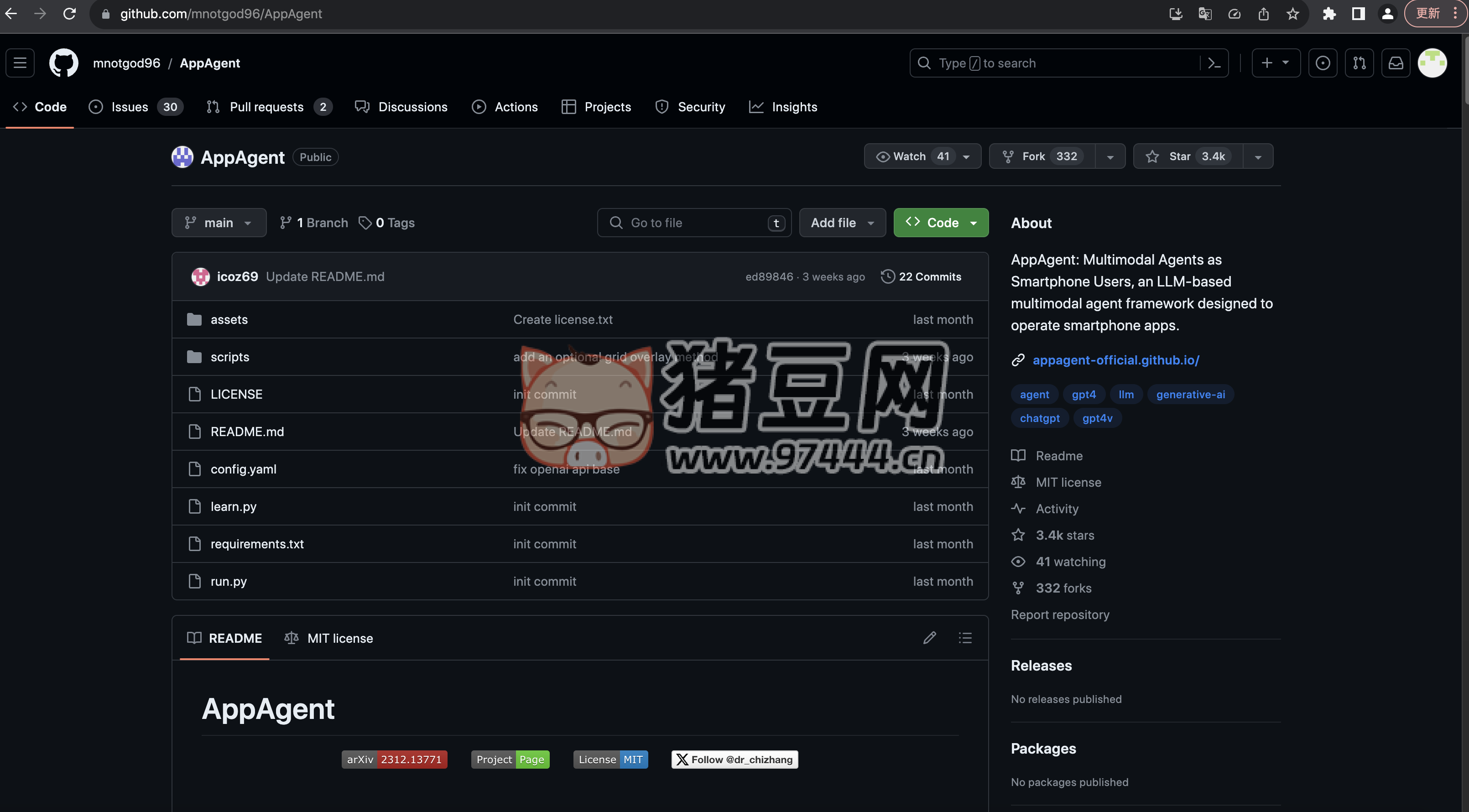

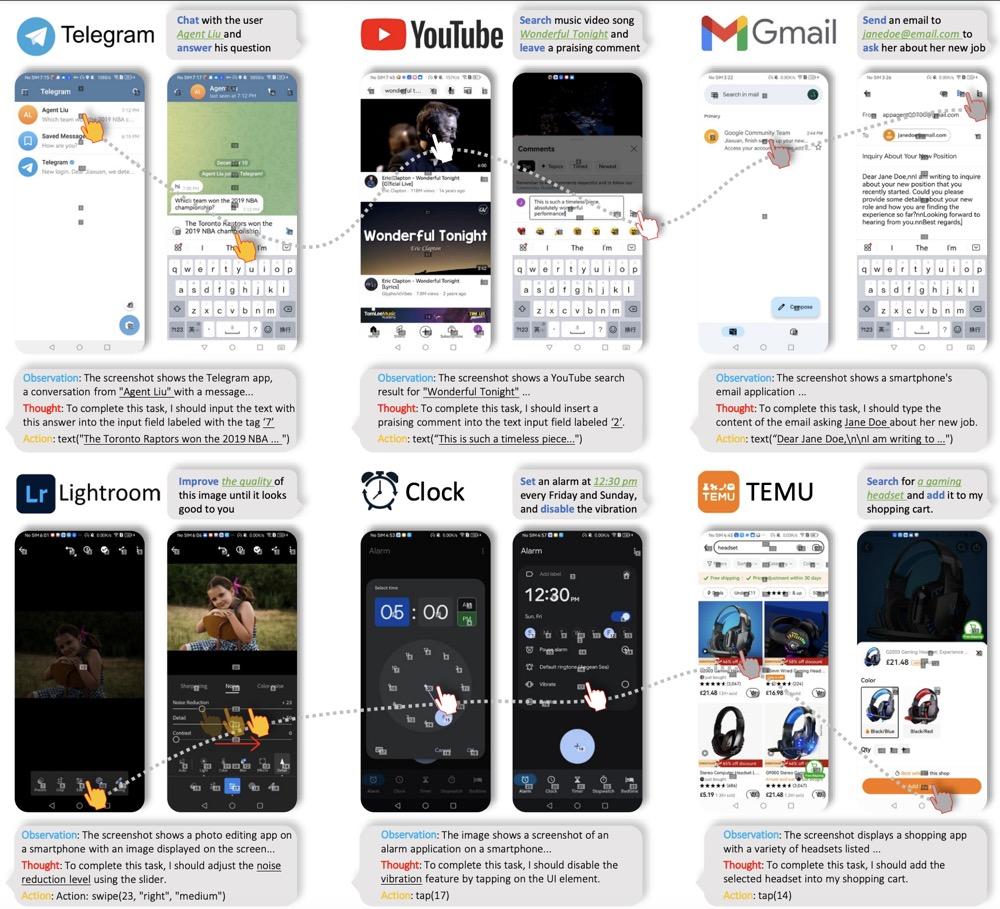

AppAgent – 是一个创新的基于大型语言模型(LLM)的多模态代理框架,设计用于操作智能手机应用程序。

Github:https://github.com/mnotgod96/AppAgent

介绍

我们介绍了一种新的基于 LLM 的多模式代理框架,旨在操作智能手机应用程序。

我们的框架使代理能够通过简化的动作空间操作智能手机应用程序,模仿类似人类的互动,如敲击和滑动。这种新颖的方法绕过了对系统后端访问的需求,从而扩大了其在各种应用程序中的适用性。

我们的代理功能的核心是其创新的学习方法。代理通过自主探索或观察人类演示来学习导航和使用新应用程序。这个过程生成一个知识库,代理在不同的应用程序中执行复杂任务时参考该知识库。

效果图

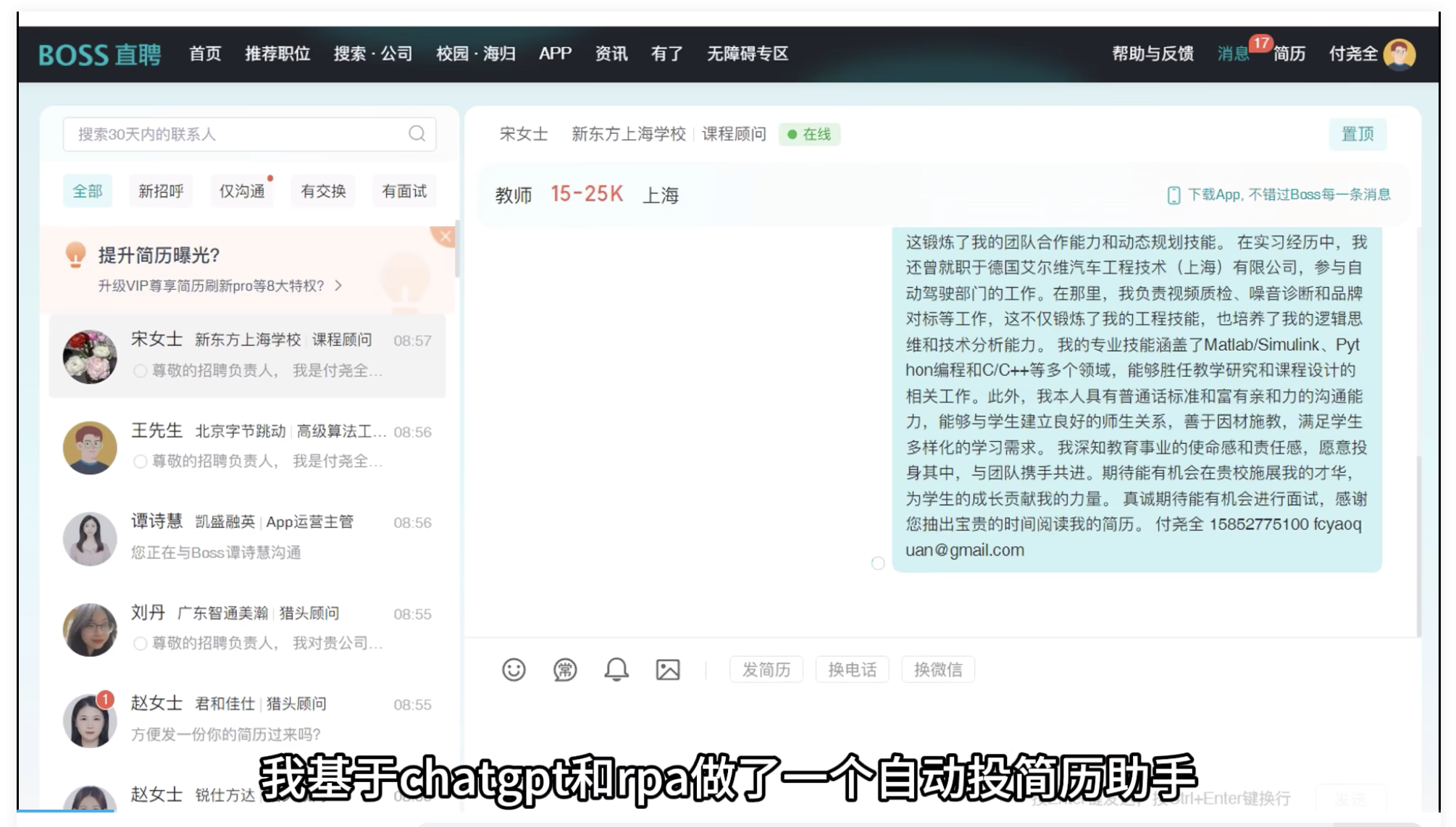

auto_job__find__ chat gpt__rpa- 使用 ChatGPT 制作一个自动投简历的开源工具。

Github:https://github.com/Frrrrrrrrank/auto_job__find__chatgpt__rpa

介绍

这是一个完全免费的脚本,只需要你们自己配置好 openai 的 api 即可

希望您能给我点个 star

如果在这个寒冷的招聘季,这个脚本能给您一些帮助,带来一些 温暖 ,将让我非常荣幸

希望不要有人拿着我的脚本去割韭菜,都已经被逼到用这种脚本投简历的地步了,身上也没啥油水可榨了吧。

操作步骤

- 请首先配置好 openai 的 api(使用.env 文件或者在代码中配置)

- 将 pdf 简历上传到文件夹 auto_job_find 里,命名为 “my_cover.pdf”

- 将需要的包安装好

- 执行 write_response.py

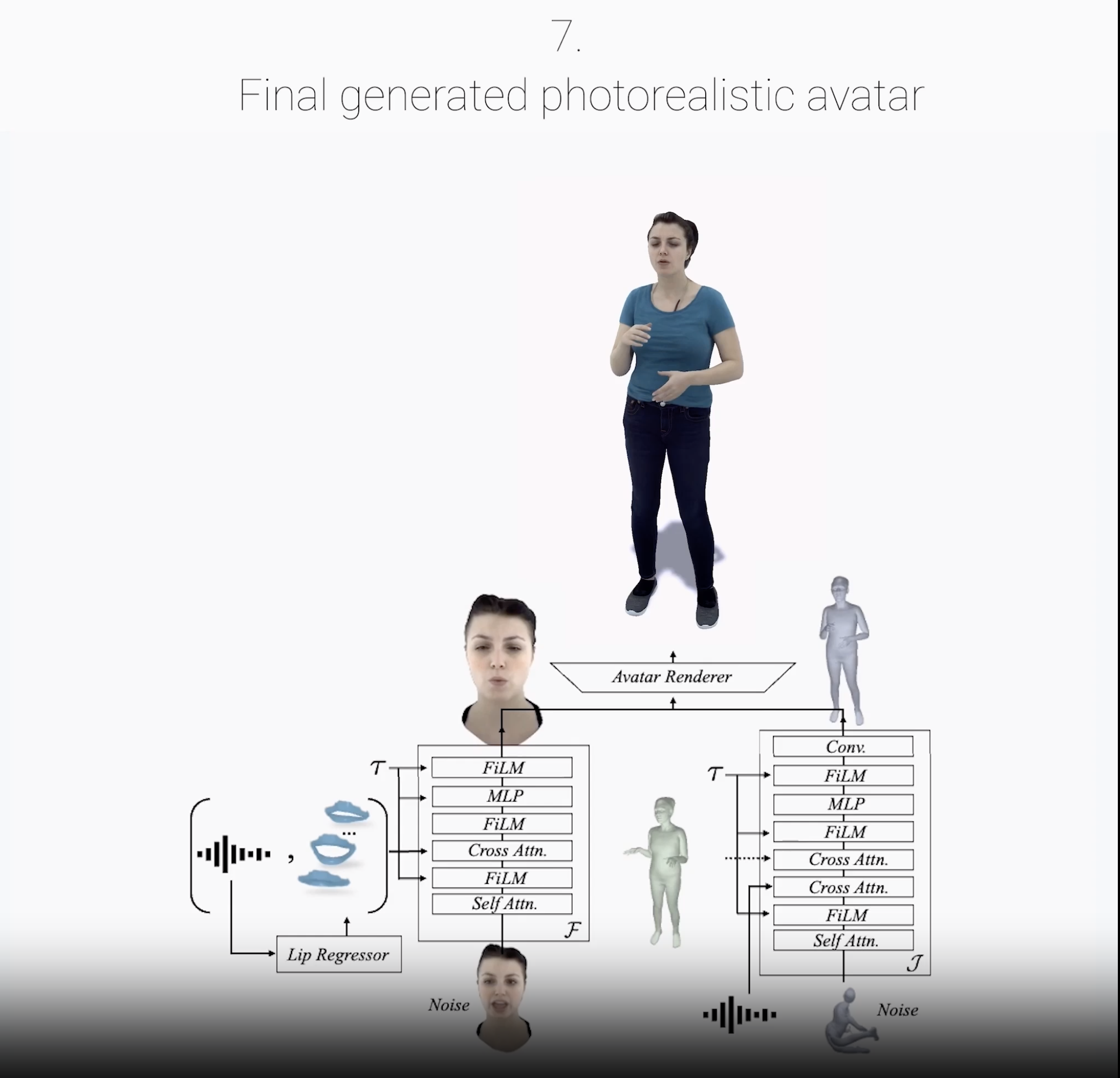

audio2photoreal – 这个项目可以从音频生成逼真的人物形象,该项目包含了训练代码、测试代码、预训练的动作模型以及数据集。

Github:https://github.com/facebookresearch/audio2photoreal

该项目还没有发布两个星期在 Github 上 Star 2.2k。

audio2photoreal 开源项目由 Facebook Research 开源。这个项目可以从音频生成逼真的人物形象,该项目包含了训练代码、测试代码、预训练的动作模型以及数据集。

效果图

Awesome-gptlike-shellsite – 深入探索了精选的”套壳站”和必备 ChatGPT 应用 API 资源。

Github:https://github.com/bleedline/Awesome-gptlike-shellsite

介绍

深入探索精选的套壳站和必备 API 资源。本项目为初学者和经验丰富的 运营 者提供一站式指南,涵盖常见问题解答和基础攻略,助您迈向套壳站副业 成功 之路。

目前项目接受优质的 AI 站点部署资源,包括但不限于 API,套壳站,云服务器,可以加入开发者们的链接。

去哪里找壳比较好:Github 上有一些开源的项目,我们为大家整理了一些,但是更多需求还需自己去寻找合适的 ” 壳 ”。

千言万语,不然一张长图,具体如下图:

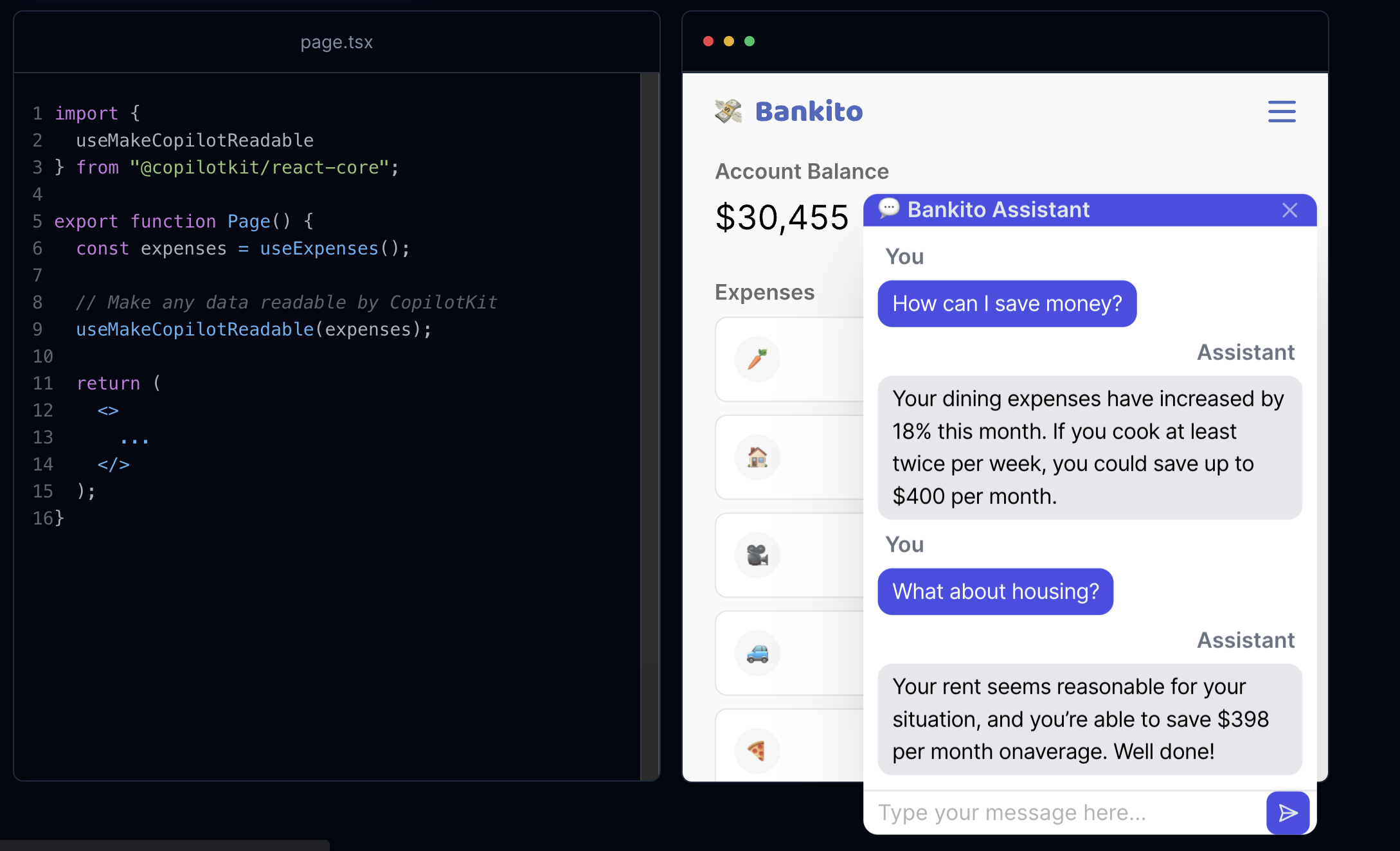

CopilotKit – AI 聊天机器人工具。

Github:https://github.com/CopilotKit/CopilotKit

介绍

CopilotKit 是一个用于在 react web 应用中构建应用内 AI 聊天机器人和 AI 驱动的文本区域的库。

CopilotKit 是一个开源平台,它提供了两个核心组件:CopilotPortal 和 CopilotTextarea。这两个组件共同工作,为用户提供了一个无缝的 AI 增强体验。

CopilotPortal是一个能够“看到”当前应用状态并执行操作的AI 聊天机器人。它不仅能够与应用的 前端 和后端进行通信,还能通过插件与第三方服务如 Salesforce 和 Drop box 等进行交互。想象一下,你的用户可以在应用内直接与 AI 对话,获取即时的帮助和操作指导,这无疑将极大地提升 用户体验 和效率。

CopilotTextarea 是一个智能 文本编辑器 ,它能够提供上下文感知的自动补全、AI 编辑以及从零开始生成内容的功能。这意味着用户在编写文本时,CopilotTextarea 能够根据上下文提供合适的建议,甚至自动完成句子。这种智能化的编辑体验将极大地提高文本创作的效率和质量。

特性

- 支持多种流行的 AI 模型, 如 ChatGPT、Anthropic、Cohere 等

- 易于集成到现有的 react 应用中

- 提供应用内聊天界面和 AI 驱动的富文本组件

- 灵活的配置选项和回调函数

- 支持自定义 UI 和样式

- 开源, 免费使用

CopilotKit 使开发者可以非常方便地在他们的 web 应用中加入 AI 功能, 如让用户与聊天机器人互动、提供 AI 辅助的文本输入等。它抽象了底层的 AI 服务调用逻辑, 开发者只需简单配置就可以使用。

总结

总而言之,AI 大模型代表了人工智能领域的一次突破。它们通过巨大的参数规模和强大的学习能力,将人工智能技术带入了一个全新的阶段。尽管 AI 大模型面临一些挑战,但随着技术的不断进步和发展,相信这些模型将在 未来 的各个领域中发挥重要作用,为人类带来更多的便利和创新。

评论列表

发表评论